Le Poids des opinions

Pourquoi la politique nous rend bêtes

20-04-2017

Pourquoi est-ce qu'on change si rarement d'avis en politique ? C'est notamment à cause du biais de confirmation : un réflexe psychologique qui fait qu’on déforme toujours les faits pour les aligner avec nos opinions préexistantes. Et ça, tout particulièrement quand on parle politique...

Et ce biais de confirmation, mieux vaut le comprendre avant d'aller voter dimanche. On vous explique tout plus bas.

Temps de lecture : environ 7 minutes

-----------------

Le 21 décembre 1954, il était censé se passer un truc de ouf.

Selon Marian Keech, une femme au foyer de Chicago, c’est à cette date qu’un tsunami géant allait engloutir la planète.

De qui elle tenait l’info ? Marian ne s’en cachait pas : son scoop, elle le devait à un groupe d’extraterrestres.

Et pourtant… aussi improbable que ça paraisse, Marian a réussi à convaincre pas mal de personnes, non seulement de l’imminence de la menace, mais aussi qu’un salut était possible : les extraterrestres allaient envoyer une soucoupe volante pour sauver Marian et ses potes. Du coup, les adeptes de Marian quittèrent leur job, et même parfois leur famille, pour attendre tous ensemble le vaisseau spatial qui devait les sauver de l’apocalypse...

Et alors, le 21 décembre, ¿que pasó ? Nada, évidemment. Pas de E.T, et le groupe est abasourdi.

Mais est-ce qu’ils se disent pour autant qu’ils se sont complètement plantés ?

Pas du tout, et c’est même tout le contraire. Le soir-même, Marian Keech dit avoir reçu un nouveau message de la part des petits hommes verts : “le cataclysme a été annulé car le petit groupe, assis toute la nuit, avait répandu tant de lumière que Dieu a finalement décidé de sauver le monde de la destruction”. Pour le groupe, le miracle est encore plus grand… Et, renforcés dans leur croyance, ils cherchent plus que jamais à évangéliser le reste du monde.

Comment le groupe a-t-il pu persister dans sa croyance alors que, rationnellement, tout leur prouvait qu’ils s’étaient trompés ?

Cette capacité à persister dans l’erreur malgré les évidences, c’est lié à ce que Léon Festinger, un prof du MIT, a appelé le biais de confirmation : un concept qu’il décrit dans son classique L’Echec d’une prophétie, paru en 1956, et dans lequel il raconte l’histoire de Marian Keech. Ce que ça veut dire ? Le biais de confirmation consiste à déformer les arguments ou les faits objectifs pour les faire correspondre avec sa propre vision de la réalité.

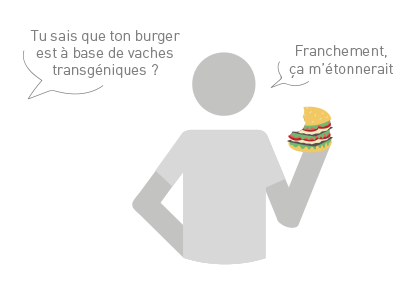

Et ça, c’est quelque chose qu’on fait souvent dans la vie de tous les jours - on appelle ça de la mauvaise foi, une opinion différente ou même une “vérité alternative”. Mais pourquoi est-ce que, dans un monde aussi informé que le nôtre, on n’arrive jamais à établir des consensus sur la voie à suivre ? Par exemple, sur le changement climatique ? Ou encore, sur le choix du candidat à élire ?

La réponse, elle vient notamment du biais de confirmation. Parce que non, celui-ci ne touche pas que les illuminés qui attendent l’arrivée des martiens... En fait, il touche tout le monde.

I / COMMENT LE BIAIS DE CONFIRMATION DEFORME NOTRE JUGEMENT

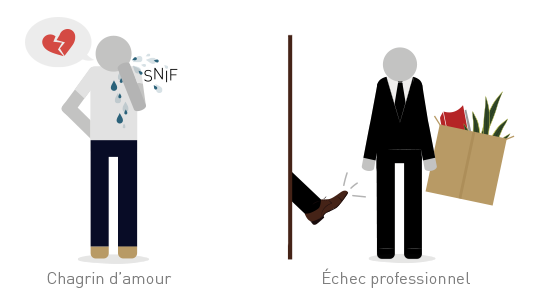

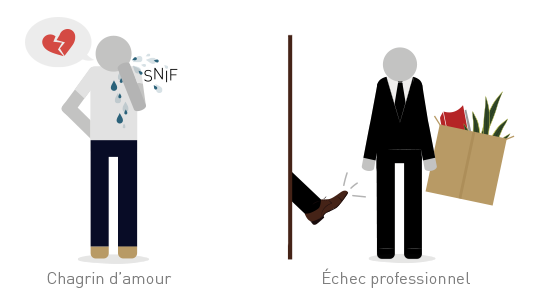

On a tous déjà expérimenté une des situations suivantes :

Pourtant, si on remonte un peu en arrière, les mêmes personnes disaient ça :

Partenaire de rêve ? Boulot idéal ? Face à l’échec… plus tellement. Critiquer ce qui nous échappe ou dévaloriser ce qu’on n’arrive pas à atteindre : c’est un petit arrangement avec les faits qui paraît assez humain, un mécanisme de self-défense assez compréhensible.

Sauf que…

De la même manière que le biais de confirmation ne concerne pas uniquement des illuminés, il ne concerne pas non plus uniquement des situations sentimentales ou éminemment subjectives. Il déforme également la perception que l’on a de sujets qu’on pourrait considérer comme nettement plus objectifs.

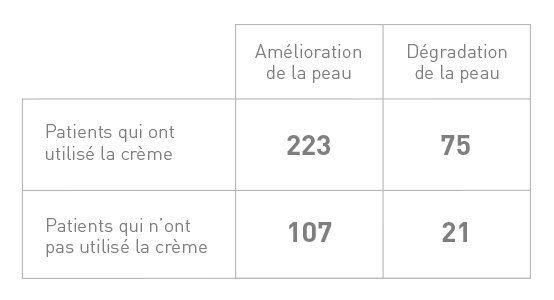

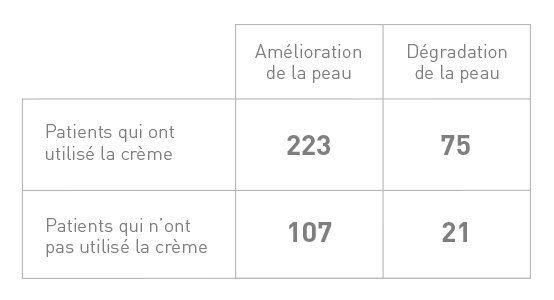

C’est notamment ce qu’a prouvé le prof de droit de Yale Dan Kahan. En 2013, il a mené une expérience dans laquelle il montrait à un échantillon test de plus de 1 000 Américains le tableau suivant :

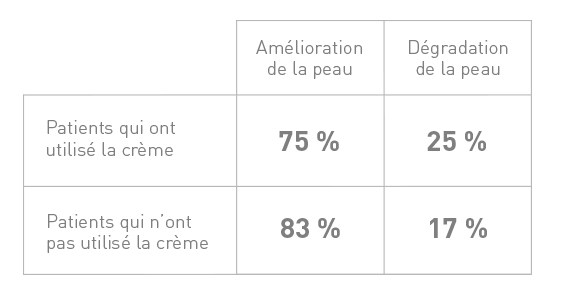

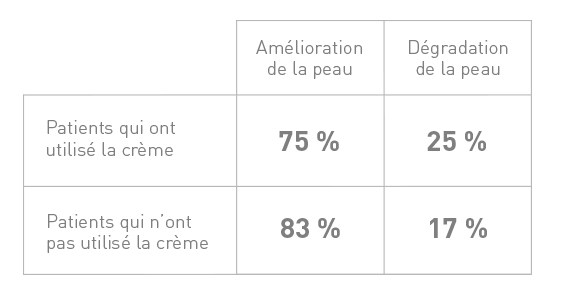

Le résultat ? Il y a un piège, mais comme on a tous fais des maths au collège et qu’on maîtrise parfaitement la règle de trois (non ?)... vous n’êtes certainement pas tombés dedans. Après un rapide calcul, on s’aperçoit que même si, en valeur absolue, on a l’impression que beaucoup de personnes ont amélioré leur peau grâce à la crème, quand on regarde les pourcentages, ça a une autre tête :

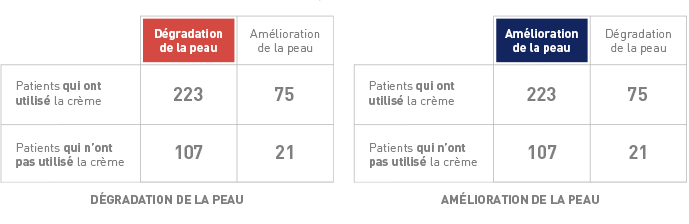

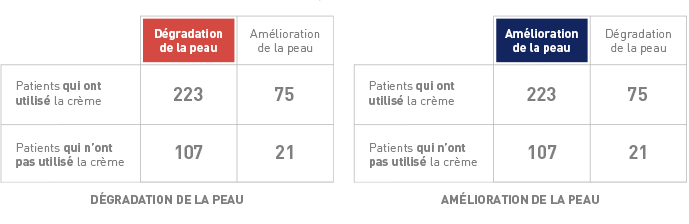

Pour son enquête, Dan Kahan a ensuite soumis le même tableau aux individus test… mais avec des légendes légèrement différentes.

D’abord, il leur a montré deux versions du tableau : une qui prouvait que la crème améliorait la peau, l’autre qui montrait le contraire. Dans les deux cas, les sujets analysaient correctement les données.

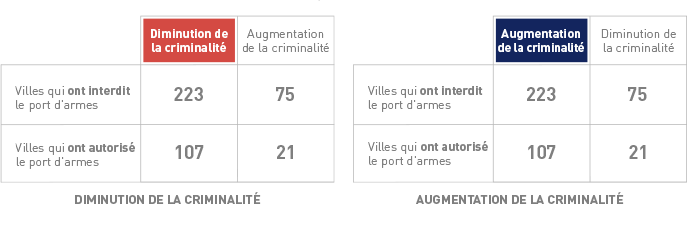

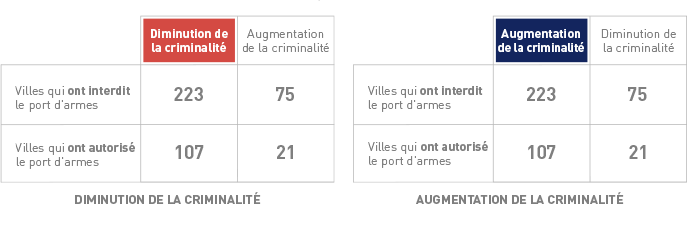

Puis, il leur a montré le même tableau, mais sur un sujet différent : la corrélation entre le port d’armes et la criminalité (sujet évidemment hyper sensible aux US…).

Ce dont il s’aperçoit ? C’est que, quand il s’agissait de la crème, la capacité des sujets à interpréter correctement les données étaient indexée sur une chose : leur niveau de maths.

En revanche, sur un sujet plus sensible comme le port d’armes, la règle de trois n’était plus qu’un lointain souvenir.... D’un seul coup, la bonne analyse ne dépendait plus du niveau de maths mais du positionnement politique : plus les données contredisent leurs opinions, et plus les individus ont tendance à mal les interpréter.

Ce que Dan Kahan a montré, c’est que selon les thèmes, les jugements rationnels des individus pouvaient être significativement perturbés par leurs opinions politiques. Quelque chose qu’on a tous déjà constaté pendant nos déjeuners de famille...

Pourquoi ? Parce que le biais de confirmation est d’autant plus fort qu’il touche à des croyances centrales de l’identité et du système de valeurs d’une personne. Dans son jargon, Kahan a appelé cela la cognition protectrice de l’identité : pour éviter de remettre en cause une donnée clé de leur appartenance sociale, les individus préfèrent ne pas prendre en compte les faits qui contredisent leurs valeurs.

En gros, plus on évoque un sujet qui nous touche de près, et plus notre capacité à l’envisager de manière rationnelle va diminuer… et plus ce sera difficile de tomber d’accord avec quelqu’un.

Mais au fait, pourquoi les opinions politiques sont-elles un sujet aussi sensible ?

Pour le comprendre, il faut d’abord essayer de comprendre comment se forment nos opinions.

II / LA CONSTRUCTION DE L'OPINION POLITIQUE

Dans un monde ultra-rationnel, chaque Français serait un électeur éclairé, libre de toute influence, choisissant son vote en fonction de son intérêt, des enjeux du moment et des programmes des candidats. Il trouverait toutes les informations nécessaires dans les médias. Et comme on dispose de plus en plus d’informations et que le niveau d’éducation ne cesse de progresser, tout ça irait de mieux en mieux : le résultat des urnes désignerait alors le candidat qui serait objectivement le meilleur pour les Français.

Bien sûr, ce n’est pas du tout le cas.

En réalité, on ne vote pas seulement en fonction de son intérêt, mais aussi en fonction de son idéologie, c’est-à-dire d’un système de valeurs et de croyances ancré en nous.

Par exemple, on peut voter pour un candidat qui prône plus de redistribution alors qu’on a un revenu élevé… ou voter pour un candidat qui veut durcir les conditions d’allocation chômage alors qu’on vient de perdre son boulot.

En gros, chacun d’entre nous est prêt à consentir certaines pertes matérielles pour ne pas avoir à remettre en cause sa vision du monde.

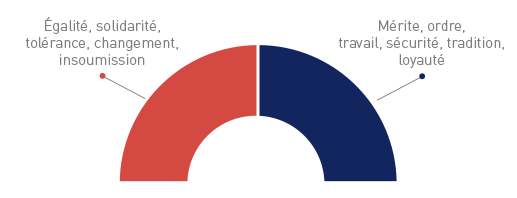

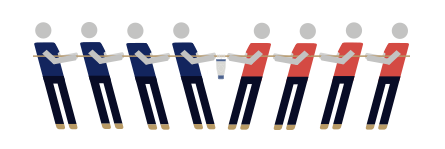

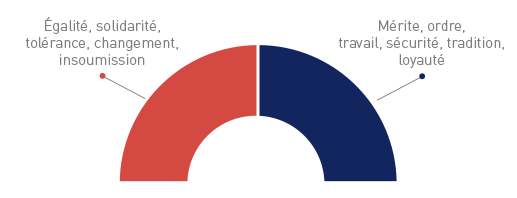

De quelles idéologies parle-t-on ? Dans à peu près tous les pays du monde, les idéologies politiques se structurent autour de deux grandes tendances : la “gauche” et la “droite”. Ça, ça vient de la Révolution Française, quand les députés de l’assemblée constituante siégeaient à droite du président quand ils étaient favorables à la Monarchie, et à gauche quand ils voulaient plutôt destituer le roi.

Et traditionnellement, on résume les valeurs de gauche et de droite à peu près comme ça :

Bref, pour comprendre comment se forme notre vote, il faut d’abord comprendre comment se forme notre idéologie. Elle se forme sous l’influence de deux facteurs :

1 - Le facteur psychologique

Notre idéologie se forme très tôt dans la vie, dans ce qu’on appelle la phase de “socialisation primaire”, au contact notamment de sa famille, d’un ami qui compte ou d’un prof qu’on admire. Et cette transmission de valeurs et de croyances est extrêmement puissante : selon la sociologue Anne Muxel, seuls 10 à 12% des enfants reconnaissent avoir fait une rupture radicale par rapport au bord politique de leurs parents… Dans The American Voter parue en 1960, des chercheurs de l’université de Michigan ont établi que l’identification partisane gauche / droite donnée par les parents était non seulement le principal déterminant du vote, mais qu’en plus, elle augmentait avec l’âge…

2 - Le facteur sociologique

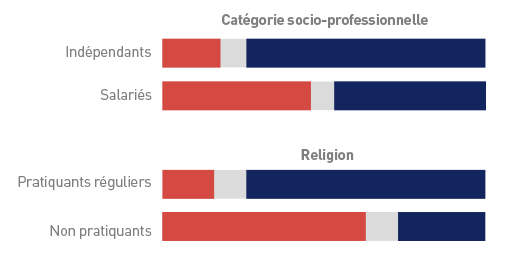

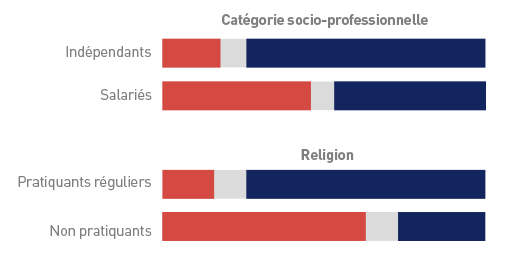

L’âge, la religion, la catégorie socioprofessionnelle sont aussi des facteurs déterminants de notre idéologie. Exemples (sources ici) :

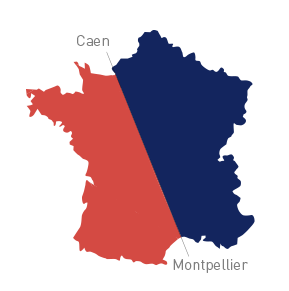

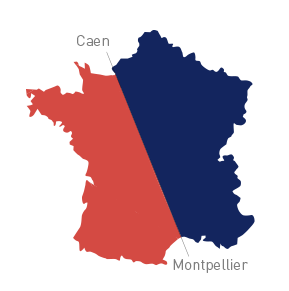

Et ça marche même pour la géographie :

Ce ne sont bien sûr que des tendances, et chacun reste libre de voter ce qu’il veut, mais ce qu’il est important de comprendre, c’est que notre vote est profondément influencé par le système de valeurs transmis par notre famille, notre catégorie sociale ou notre environnement. Il définit notre identité. C’est ce qui fait que changer d’avis politique, c’est remettre en cause qui on est. Et c’est pour ça qu’en matière de politique, le biais de confirmation est beaucoup plus puissant qu’ailleurs...

Et depuis quelques années, les nouveaux modes de consommation de l’info ont encore renforcé son poids.

III / COMMENT LES NOUVEAUX MEDIAS AMPLIFIENT LE BIAIS DE CONFIRMATION

Les coupables, les voilà :

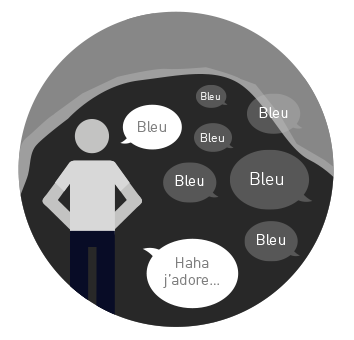

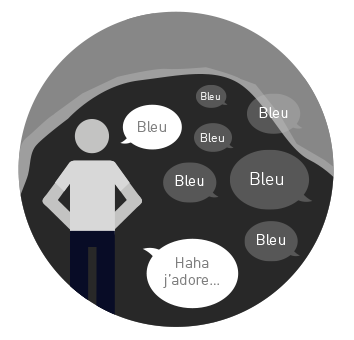

En 2016, plus de 51% de la population utilisaient les réseaux sociaux comme source d’information. Le problème ? C’est ce que les réseaux agissent comme ce que les chercheurs appellent une chambre aux échos. Quand on parle, la chambre nous renvoie exactement ce qu’on a dit - comme un écho.

L’algorithme de Facebook nous favorise les contenus sur lesquels on a déjà cliqué… c’est à dire, très souvent, ce qui va dans le sens de nos convictions. Exemple : si vous êtes un climato-sceptique convaincu, vous risquez de ne lire que des articles qui confirmeront votre opinion...

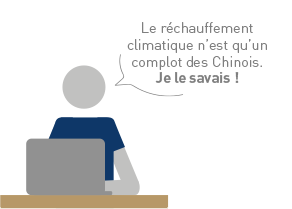

Sur Google, avec les milliards de résultats possibles, on trouve aussi toujours un résultat de recherche qui va dans le sens de nos convictions. Exemple : si vous êtes un fervent anticapitaliste, vous trouverez probablement des articles qui vous plairont :

En revanche, il est peu probable que vous tombiez par hasard sur des informations contradictoires à vos convictions initiales. C’est notamment ce qui a fait que beaucoup d’Américains démocrates n’avaient pas vu venir l’élection de Trump, « enfermés » dans leur chambre aux échos. Ce journaliste de Wired décrit par exemple comment un article “Why I vote for Trump” partagé 1,5 million de fois sur Facebook n’est jamais parvenu sur son newsfeed Facebook...

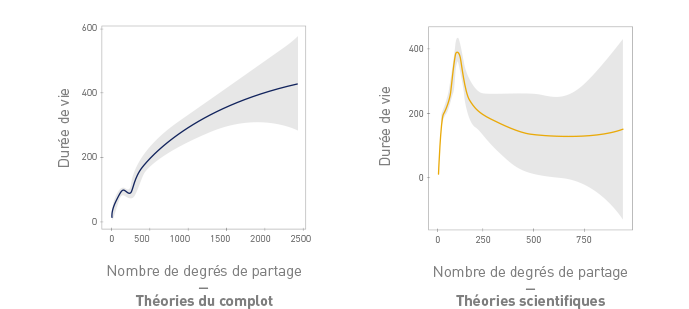

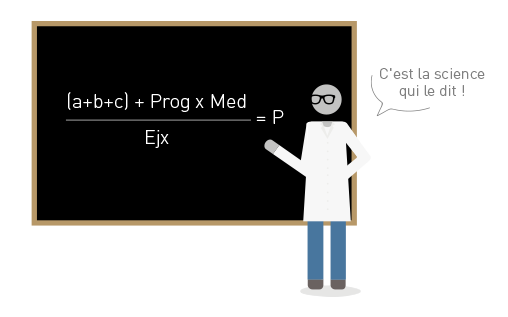

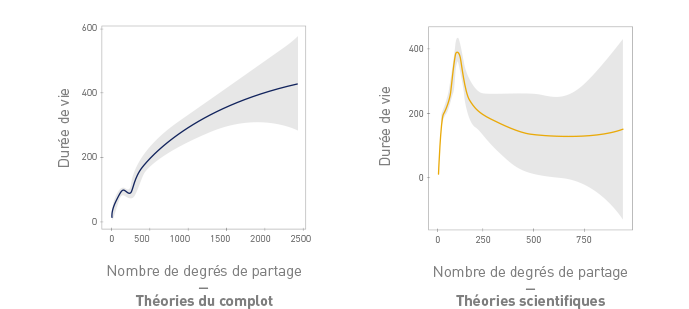

Ce mécanisme crée donc du clivage et de la division en soudant les communautés autour d’opinions communes, même quand elles sont erronées. Le plus flippant : une étude italienne qui montre que ces “fake news” se propagent plus vite sur le web que les véritables informations scientifiques… grâce à la logique du like et du partage.

Pire encore : certains médias se spécialisent même dans ces “fake facts”, comme le média Russe Sputnik dont le slogan est “Telling the Untold” ou Breitbart aux US, un média très lu notamment par l’électorat populaire de Trump. (Mais celui qui parle le mieux de ça, c’est encore John Oliver dans cette vidéo).

En gros, le biais de confirmation est un réflexe assez naturel de l’être humain. Ce qui change, c’est que le ciblage des contenus qu’on trouve sur les réseaux sociaux ne nous aide vraiment pas à le combattre… Et il faut faire un effort de plus en plus important pour aller consulter des sources d’information contradictoires.

Difficile ? Oui, mais vraiment pas impossible.

Alors, comment se faire de meilleures opinions ?

Si notre biais de confirmation joue trop fort, si on ne va jamais chercher aucune information contradictoire, on risque aussi de se faire enfermer dans des idéologies extrêmes. Ce qui est arrivé aux Etats-Unis avec l’élection de Trump, et c’est aussi ce qui peut arriver en France pour les élections présidentielles.

Il nous reste trois jours avant dimanche pour diminuer ce biais de confirmation. Voici ce qu’on vous propose :

1/ D’abord, il faut prendre conscience de notre biais de confirmation, que nous avons tous, quelles que soient nos positions. Le génie de la publicité William Bernbach - un des modèles de la série Mad Men - avait toujours dans la poche de sa veste une petite carte qui disait “Maybe he's right”. Alors la prochaine fois que vous entendez un ami qui donne un avis que vous pensez absurde, ayez en vous une petite voix pour vous souffler “Peut-être qu’il a raison”.

2/ Ensuite, plus que jamais, il faut s’ouvrir aux avis contraires. Sortez de votre chambre aux échos en vous efforçant de regarder ou de lire des médias qui défendent un autre point de vue que le vôtre. Vous êtes plutôt à gauche ? Allez jeter un coup d’oeil au Figaro ou au Point. Vous êtes plutôt à droite ? Libération et Marianne vous attendent dans tous les kiosques.

3/ Allez jeter un oeil à un comparateur de programme, comme par exemple celui de Voxe.

Et pour qu’un maximum de personnes prennent conscience de leur biais de confirmation et s’ouvrent aux avis contraires, vous savez ce qui vous reste à faire :

Et ce biais de confirmation, mieux vaut le comprendre avant d'aller voter dimanche. On vous explique tout plus bas.

Temps de lecture : environ 7 minutes

-----------------

Le 21 décembre 1954, il était censé se passer un truc de ouf.

Selon Marian Keech, une femme au foyer de Chicago, c’est à cette date qu’un tsunami géant allait engloutir la planète.

De qui elle tenait l’info ? Marian ne s’en cachait pas : son scoop, elle le devait à un groupe d’extraterrestres.

Et pourtant… aussi improbable que ça paraisse, Marian a réussi à convaincre pas mal de personnes, non seulement de l’imminence de la menace, mais aussi qu’un salut était possible : les extraterrestres allaient envoyer une soucoupe volante pour sauver Marian et ses potes. Du coup, les adeptes de Marian quittèrent leur job, et même parfois leur famille, pour attendre tous ensemble le vaisseau spatial qui devait les sauver de l’apocalypse...

Et alors, le 21 décembre, ¿que pasó ? Nada, évidemment. Pas de E.T, et le groupe est abasourdi.

Mais est-ce qu’ils se disent pour autant qu’ils se sont complètement plantés ?

Pas du tout, et c’est même tout le contraire. Le soir-même, Marian Keech dit avoir reçu un nouveau message de la part des petits hommes verts : “le cataclysme a été annulé car le petit groupe, assis toute la nuit, avait répandu tant de lumière que Dieu a finalement décidé de sauver le monde de la destruction”. Pour le groupe, le miracle est encore plus grand… Et, renforcés dans leur croyance, ils cherchent plus que jamais à évangéliser le reste du monde.

Comment le groupe a-t-il pu persister dans sa croyance alors que, rationnellement, tout leur prouvait qu’ils s’étaient trompés ?

Cette capacité à persister dans l’erreur malgré les évidences, c’est lié à ce que Léon Festinger, un prof du MIT, a appelé le biais de confirmation : un concept qu’il décrit dans son classique L’Echec d’une prophétie, paru en 1956, et dans lequel il raconte l’histoire de Marian Keech. Ce que ça veut dire ? Le biais de confirmation consiste à déformer les arguments ou les faits objectifs pour les faire correspondre avec sa propre vision de la réalité.

Et ça, c’est quelque chose qu’on fait souvent dans la vie de tous les jours - on appelle ça de la mauvaise foi, une opinion différente ou même une “vérité alternative”. Mais pourquoi est-ce que, dans un monde aussi informé que le nôtre, on n’arrive jamais à établir des consensus sur la voie à suivre ? Par exemple, sur le changement climatique ? Ou encore, sur le choix du candidat à élire ?

La réponse, elle vient notamment du biais de confirmation. Parce que non, celui-ci ne touche pas que les illuminés qui attendent l’arrivée des martiens... En fait, il touche tout le monde.

I / COMMENT LE BIAIS DE CONFIRMATION DEFORME NOTRE JUGEMENT

On a tous déjà expérimenté une des situations suivantes :

Pourtant, si on remonte un peu en arrière, les mêmes personnes disaient ça :

Partenaire de rêve ? Boulot idéal ? Face à l’échec… plus tellement. Critiquer ce qui nous échappe ou dévaloriser ce qu’on n’arrive pas à atteindre : c’est un petit arrangement avec les faits qui paraît assez humain, un mécanisme de self-défense assez compréhensible.

Sauf que…

De la même manière que le biais de confirmation ne concerne pas uniquement des illuminés, il ne concerne pas non plus uniquement des situations sentimentales ou éminemment subjectives. Il déforme également la perception que l’on a de sujets qu’on pourrait considérer comme nettement plus objectifs.

C’est notamment ce qu’a prouvé le prof de droit de Yale Dan Kahan. En 2013, il a mené une expérience dans laquelle il montrait à un échantillon test de plus de 1 000 Américains le tableau suivant :

Le résultat ? Il y a un piège, mais comme on a tous fais des maths au collège et qu’on maîtrise parfaitement la règle de trois (non ?)... vous n’êtes certainement pas tombés dedans. Après un rapide calcul, on s’aperçoit que même si, en valeur absolue, on a l’impression que beaucoup de personnes ont amélioré leur peau grâce à la crème, quand on regarde les pourcentages, ça a une autre tête :

Pour son enquête, Dan Kahan a ensuite soumis le même tableau aux individus test… mais avec des légendes légèrement différentes.

D’abord, il leur a montré deux versions du tableau : une qui prouvait que la crème améliorait la peau, l’autre qui montrait le contraire. Dans les deux cas, les sujets analysaient correctement les données.

Puis, il leur a montré le même tableau, mais sur un sujet différent : la corrélation entre le port d’armes et la criminalité (sujet évidemment hyper sensible aux US…).

Ce dont il s’aperçoit ? C’est que, quand il s’agissait de la crème, la capacité des sujets à interpréter correctement les données étaient indexée sur une chose : leur niveau de maths.

Pour les cosmétiques, les analyses sont assez homogènes...

En revanche, sur un sujet plus sensible comme le port d’armes, la règle de trois n’était plus qu’un lointain souvenir.... D’un seul coup, la bonne analyse ne dépendait plus du niveau de maths mais du positionnement politique : plus les données contredisent leurs opinions, et plus les individus ont tendance à mal les interpréter.

Pour les sujets politiques, beaucoup moins...

Ce que Dan Kahan a montré, c’est que selon les thèmes, les jugements rationnels des individus pouvaient être significativement perturbés par leurs opinions politiques. Quelque chose qu’on a tous déjà constaté pendant nos déjeuners de famille...

Pourquoi ? Parce que le biais de confirmation est d’autant plus fort qu’il touche à des croyances centrales de l’identité et du système de valeurs d’une personne. Dans son jargon, Kahan a appelé cela la cognition protectrice de l’identité : pour éviter de remettre en cause une donnée clé de leur appartenance sociale, les individus préfèrent ne pas prendre en compte les faits qui contredisent leurs valeurs.

En gros, plus on évoque un sujet qui nous touche de près, et plus notre capacité à l’envisager de manière rationnelle va diminuer… et plus ce sera difficile de tomber d’accord avec quelqu’un.

Mais au fait, pourquoi les opinions politiques sont-elles un sujet aussi sensible ?

Pour le comprendre, il faut d’abord essayer de comprendre comment se forment nos opinions.

II / LA CONSTRUCTION DE L'OPINION POLITIQUE

Dans un monde ultra-rationnel, chaque Français serait un électeur éclairé, libre de toute influence, choisissant son vote en fonction de son intérêt, des enjeux du moment et des programmes des candidats. Il trouverait toutes les informations nécessaires dans les médias. Et comme on dispose de plus en plus d’informations et que le niveau d’éducation ne cesse de progresser, tout ça irait de mieux en mieux : le résultat des urnes désignerait alors le candidat qui serait objectivement le meilleur pour les Français.

Bien sûr, ce n’est pas du tout le cas.

En réalité, on ne vote pas seulement en fonction de son intérêt, mais aussi en fonction de son idéologie, c’est-à-dire d’un système de valeurs et de croyances ancré en nous.

Par exemple, on peut voter pour un candidat qui prône plus de redistribution alors qu’on a un revenu élevé… ou voter pour un candidat qui veut durcir les conditions d’allocation chômage alors qu’on vient de perdre son boulot.

En gros, chacun d’entre nous est prêt à consentir certaines pertes matérielles pour ne pas avoir à remettre en cause sa vision du monde.

De quelles idéologies parle-t-on ? Dans à peu près tous les pays du monde, les idéologies politiques se structurent autour de deux grandes tendances : la “gauche” et la “droite”. Ça, ça vient de la Révolution Française, quand les députés de l’assemblée constituante siégeaient à droite du président quand ils étaient favorables à la Monarchie, et à gauche quand ils voulaient plutôt destituer le roi.

Et traditionnellement, on résume les valeurs de gauche et de droite à peu près comme ça :

Bref, pour comprendre comment se forme notre vote, il faut d’abord comprendre comment se forme notre idéologie. Elle se forme sous l’influence de deux facteurs :

1 - Le facteur psychologique

Notre idéologie se forme très tôt dans la vie, dans ce qu’on appelle la phase de “socialisation primaire”, au contact notamment de sa famille, d’un ami qui compte ou d’un prof qu’on admire. Et cette transmission de valeurs et de croyances est extrêmement puissante : selon la sociologue Anne Muxel, seuls 10 à 12% des enfants reconnaissent avoir fait une rupture radicale par rapport au bord politique de leurs parents… Dans The American Voter parue en 1960, des chercheurs de l’université de Michigan ont établi que l’identification partisane gauche / droite donnée par les parents était non seulement le principal déterminant du vote, mais qu’en plus, elle augmentait avec l’âge…

2 - Le facteur sociologique

L’âge, la religion, la catégorie socioprofessionnelle sont aussi des facteurs déterminants de notre idéologie. Exemples (sources ici) :

Et ça marche même pour la géographie :

Ce ne sont bien sûr que des tendances, et chacun reste libre de voter ce qu’il veut, mais ce qu’il est important de comprendre, c’est que notre vote est profondément influencé par le système de valeurs transmis par notre famille, notre catégorie sociale ou notre environnement. Il définit notre identité. C’est ce qui fait que changer d’avis politique, c’est remettre en cause qui on est. Et c’est pour ça qu’en matière de politique, le biais de confirmation est beaucoup plus puissant qu’ailleurs...

Et depuis quelques années, les nouveaux modes de consommation de l’info ont encore renforcé son poids.

III / COMMENT LES NOUVEAUX MEDIAS AMPLIFIENT LE BIAIS DE CONFIRMATION

Les coupables, les voilà :

En 2016, plus de 51% de la population utilisaient les réseaux sociaux comme source d’information. Le problème ? C’est ce que les réseaux agissent comme ce que les chercheurs appellent une chambre aux échos. Quand on parle, la chambre nous renvoie exactement ce qu’on a dit - comme un écho.

L’algorithme de Facebook nous favorise les contenus sur lesquels on a déjà cliqué… c’est à dire, très souvent, ce qui va dans le sens de nos convictions. Exemple : si vous êtes un climato-sceptique convaincu, vous risquez de ne lire que des articles qui confirmeront votre opinion...

Sur Google, avec les milliards de résultats possibles, on trouve aussi toujours un résultat de recherche qui va dans le sens de nos convictions. Exemple : si vous êtes un fervent anticapitaliste, vous trouverez probablement des articles qui vous plairont :

En revanche, il est peu probable que vous tombiez par hasard sur des informations contradictoires à vos convictions initiales. C’est notamment ce qui a fait que beaucoup d’Américains démocrates n’avaient pas vu venir l’élection de Trump, « enfermés » dans leur chambre aux échos. Ce journaliste de Wired décrit par exemple comment un article “Why I vote for Trump” partagé 1,5 million de fois sur Facebook n’est jamais parvenu sur son newsfeed Facebook...

Ce mécanisme crée donc du clivage et de la division en soudant les communautés autour d’opinions communes, même quand elles sont erronées. Le plus flippant : une étude italienne qui montre que ces “fake news” se propagent plus vite sur le web que les véritables informations scientifiques… grâce à la logique du like et du partage.

Pire encore : certains médias se spécialisent même dans ces “fake facts”, comme le média Russe Sputnik dont le slogan est “Telling the Untold” ou Breitbart aux US, un média très lu notamment par l’électorat populaire de Trump. (Mais celui qui parle le mieux de ça, c’est encore John Oliver dans cette vidéo).

En gros, le biais de confirmation est un réflexe assez naturel de l’être humain. Ce qui change, c’est que le ciblage des contenus qu’on trouve sur les réseaux sociaux ne nous aide vraiment pas à le combattre… Et il faut faire un effort de plus en plus important pour aller consulter des sources d’information contradictoires.

Difficile ? Oui, mais vraiment pas impossible.

Alors, comment se faire de meilleures opinions ?

Si notre biais de confirmation joue trop fort, si on ne va jamais chercher aucune information contradictoire, on risque aussi de se faire enfermer dans des idéologies extrêmes. Ce qui est arrivé aux Etats-Unis avec l’élection de Trump, et c’est aussi ce qui peut arriver en France pour les élections présidentielles.

Il nous reste trois jours avant dimanche pour diminuer ce biais de confirmation. Voici ce qu’on vous propose :

1/ D’abord, il faut prendre conscience de notre biais de confirmation, que nous avons tous, quelles que soient nos positions. Le génie de la publicité William Bernbach - un des modèles de la série Mad Men - avait toujours dans la poche de sa veste une petite carte qui disait “Maybe he's right”. Alors la prochaine fois que vous entendez un ami qui donne un avis que vous pensez absurde, ayez en vous une petite voix pour vous souffler “Peut-être qu’il a raison”.

2/ Ensuite, plus que jamais, il faut s’ouvrir aux avis contraires. Sortez de votre chambre aux échos en vous efforçant de regarder ou de lire des médias qui défendent un autre point de vue que le vôtre. Vous êtes plutôt à gauche ? Allez jeter un coup d’oeil au Figaro ou au Point. Vous êtes plutôt à droite ? Libération et Marianne vous attendent dans tous les kiosques.

3/ Allez jeter un oeil à un comparateur de programme, comme par exemple celui de Voxe.

Et pour qu’un maximum de personnes prennent conscience de leur biais de confirmation et s’ouvrent aux avis contraires, vous savez ce qui vous reste à faire :